Citiraj:

Autor MikaHR

Jedini koji filozofira si ti. Limitiranjem FPSova jedino šro su dobili je MANJA potrošnja. Koju grafu su koristili je 100% nebitno.

|

Ok, shvaćam da je to tvoje mišljenje, a ne iskustvo tj. provjerena informacija. Upravo zato ću napraviti jedan brzi test tj. dati PROVJERENU informaciju potkrijepljenu slikama da se lakše snađeš

Citiraj:

|

Malo koja recenzija LIMITIRA fpsove i jedino što mjere je potrošnja pri MAKSIMALNIM performansama.

|

Što je i jedino logično, jer bi u suprotnom dobili limitirane performanse i sakrili razlike u performansama između grafa. Baš ono što sam naveo da je i napravljeno na AMD-ovom slajdu.

Citiraj:

|

Nebitno je da li su mjerili "iz zida" ili "na samoj grafi" ako je mjereno na obje kartice na ISTI način.

|

Molim te da ne odgovaraš na odgovore koji nisu bili namijenjeni tebi

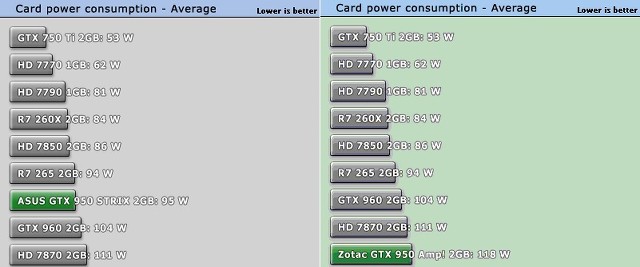

Taj odgovor je išao Manuela, jer je tvrdio da praktički sve GTX 950 grafe troše 120-140W, što nije istina, pogotovo kada se uspoređuje potrošnja sa različitih sajtova/recenzija:

Ova slika je u stvari i tebi odgovor, pošto tvrdiš da nije bitno koja grafa se koristi

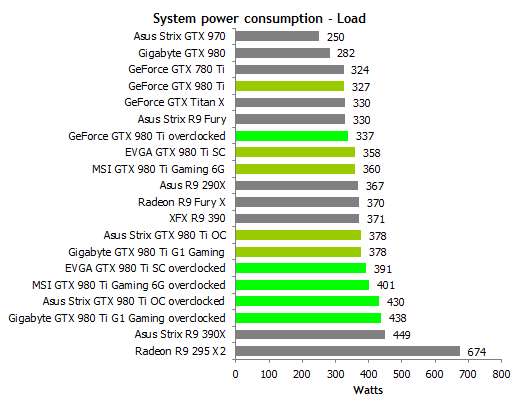

Evo i još jedan

primjer sa 980Ti različitih proizvođača, postavljenih na slične taktove (kričavo zeleni rezultati), kako bi se dobila jasna "clock per clock" usporedba u potrošnji grafičkih kartica različitih proizvođača:

Kao što vidiš tvrdnja da je nebitno koja je kartica u pitanju (kada se npr. uspoređuje potrošnja) je sama po sebi smiješna. Ovo pogotovo vrijedi u slučaju referentne kartice vs nereferentnog Asusa ili Gigabyte-a.

Citiraj:

Jedino što imaš je da su petljali po naponima i force-ali konstano visoki napon. Što je poprilično nategnuto.

Ali i dalje nebitno, kad stignu prvi primjerci će se vidjeti.

|

Ne. Po deseti put

Power Limit je glavni i zaduženi koji određuje potrošnju, a ova vrijednost je na karticama svakog proizvođača različita (određena njihovim BIOS-ima), što uzrokuje osjetne razlike u potrošnji. Naravno i efikasnost regulacije napona kod svakog proizvođača nereferentnih kartica je različita, što OPET uzrokuje razlike u potrošnji, a ovo se jasno vidi na prošloj slici.

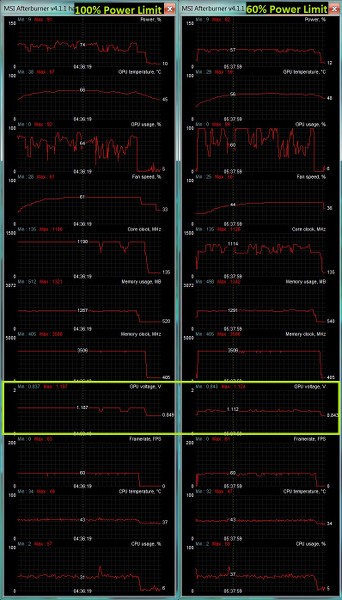

Za kraj onaj brzi test koji sam obećao na početku posta tj. informacija iz PRVE ruke

- Heaven Bench 4.0 (identičan scenarij)

-

Uključen vSync

- U oba slučaja avg. framerate je

60 FPS-a

- Lijevo grafa na 100% TDP-a (Power Limita), desno na 60%

Napon lijevo u prosjeku 1.187V, desno 1.03V (sa rijetkim skokom na 1.11V). Ove razlike izgledaju male, ali je utjecaj na potrošnju OGROMAN tj. oko 30-ak % (razlika u nominalnom TDP-u 40%).

Rezultat je 7°C manja temperatura, uz također 10% niže okretaje ventova i osjetno nižu buku grafe. Upravo ovo je najveća prednost GPU Boost tehnologije, koju većina korisnika u potpunosti zanemaruje, ne razumije ili ih jednostavno nije briga

Znam da ti niti ovo neće biti dovoljno da bi preispitao svoje dogme, ali na tvoju žalost (i našu sreću) - jedno je mišljenje, a drugo je provjerena informacija potkrijepljena dokazima